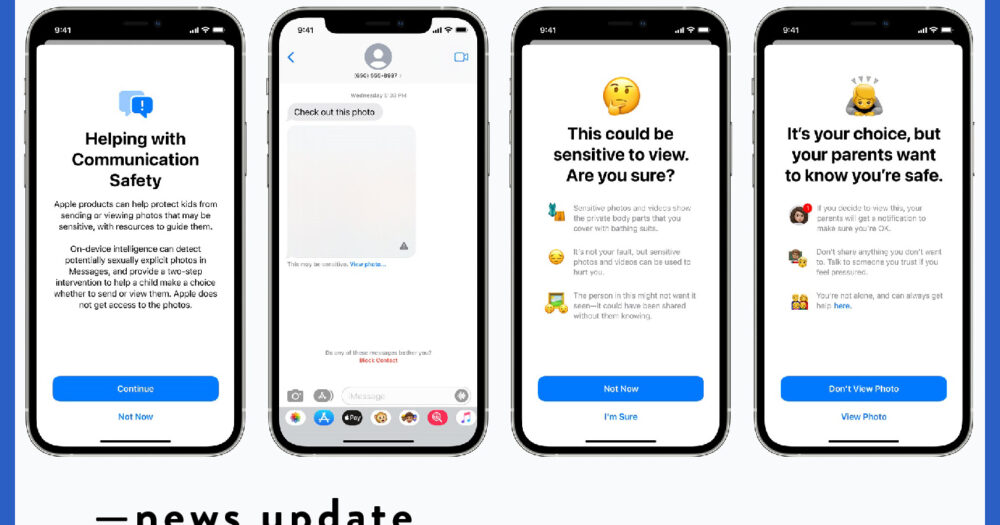

หลังจาก Apple เคยออกมายืนยันว่าจะเพิ่มระบบสำหรับตรวจจับวัตถุหรือภาพที่แสดงการล่วงละเมิดทางเพศเด็ก CSAM บนรูปภาพที่ถูกอัปโหลดเข้าสู่ iCloud ทั้งบน iPhone, iPad เพื่อตรวจสอบว่าเนื้อหาดังกล่าวมีการล่วงละเมิดทางเพศเด็กหรือไม่ ซึ่งล่าสุด Apple ได้ยุติแผนการนี้ลง เนื่องจากห่วงถึงความปลอดภัยของลูกค้าเป็นหลักในการเข้าถึงข้อมูล โดยจะหาวิธีอื่นเพิ่มเติมเพื่อปกป้องเด็กๆ..